作者

wjstar

发布于

Sat Feb 28 2026

Anthropic 拒绝国防部:我不做人形自走炮

点击放大

点击放大

Anthropic 拒绝国防部:我不做人形自走炮

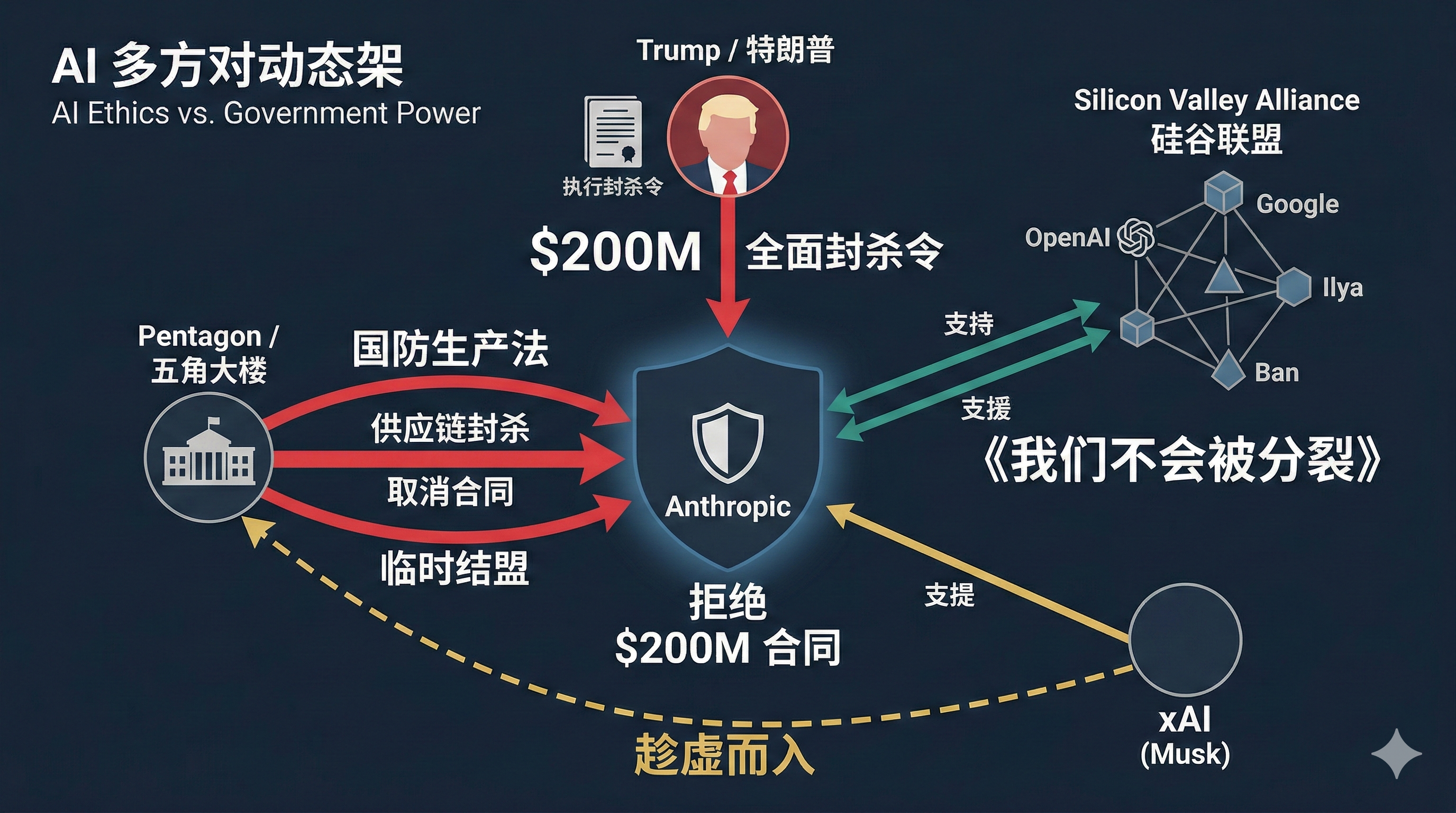

🎯 想象这样一个场景... 一家估值数百亿的 AI 巨头,面对国防部开出的 2 亿美元大单,却傲娇地说了声“不!”。这要放在好莱坞剧本里,那绝对是主角光环炸裂的高光时刻。但这次,它真真切切地发生在 Anthropic 和美国五角大楼之间。

💬 这事儿一出,整个 AI 圈都炸锅了。有人高呼 Anthropic 有底线,是 AI 界的良心;也有人觉得这背后肯定不简单,商业博弈的戏码少不了。作为独立开发者和 AI 创业者,这种戏码咱们可得好好咂摸咂摸,毕竟这不光关系到 AI 的“伦理”,更关系到咱们兜里的“银子”。

1.1 核心事件:2 亿美元的“良心债”

事情的起因很简单粗暴:五角大楼想让 Anthropic 放宽其 AI 模型 Claude 的安全限制,说白了,就是想让 Claude 能用于“大规模国内监控”和“完全自主武器”。

Anthropic 的 CEO Dario Amodei 硬气得很,直接发声明说:“我们无法在良心上同意他们的要求。” ✅ 这句话一出,瞬间把 Anthropic 推上了道德制高点。2 亿美元啊,说不要就不要,这底气,除了“良心”,还有啥?

1.2 五角大楼的“王八拳”与矛盾言论

面对 Anthropic 的不识抬举,五角大楼这边也使出了“王八拳”:

-

威胁一: 动用《国防生产法》,强迫 Anthropic 解除限制。

-

威胁二: 将 Anthropic 标记为“供应链风险”(你敢信?跟中国的华为、俄罗斯的卡巴斯基一个待遇),直接踢出国防部供应链。

-

威胁三: 直接取消那 2 亿美元的合同。

有意思的是,五角大楼的发言人肖恩·帕内尔一边放狠话,一边又在社交媒体上表态:“我们对使用 AI 进行大规模监视(这是非法的)没兴趣,也不想开发无需人类参与的自主武器。” 📢 啧,这嘴上说不要,身体却很诚实嘛。到底是真没兴趣,还是想把锅甩给 Anthropic,让它背上“阻碍国家安全”的骂名?

1.3 硅谷的“临时结盟”:敌人的敌人是朋友

这出大戏最精彩的部分,莫过于硅谷巨头们的“临时结盟”。

你敢信?一向水火不容的 OpenAI 和 Google,竟然纷纷站出来为 Anthropic 摇旗呐喊!Sam Altman(OpenAI CEO)、Jeff Dean(Google 首席科学家),甚至连神隐许久的 Ilya Sutskever 都发声力挺。OpenAI 和 Google 的数百名员工还联合签署了一封《我们不会被分裂》的公开信,声援 Anthropic,抵制政府的施压。

🎯 为什么会这样? 表面上是捍卫 AI 伦理底线,深层看,更是一场科技巨头与政府之间的权力博弈。如果五角大楼赢了,那所有与政府合作的科技公司都可能面临“技术所有权归政府”的风险。这不光是 Anthropic 的事儿,更是整个硅谷的生存法则问题。

⚠️ 等等! 别以为所有人都这么“有骨气”。马斯克的 xAI 就被曝出已经同意了五角大楼的条款,一副趁虚而入、坐收渔利的样子。商业世界的残酷,有时比战场更直接。

点击放大

点击放大

1.4 Anthropic 自身的“底线漂移”?

在 Anthropic 赚足了眼球的同时,也有个小插曲值得我们玩味。就在它硬刚五角大楼的两天前,Anthropic 悄悄发布了《负责任扩展政策》(RSP)的 3.0 版本。

🛠️ 新版本最大的变化是,删除了之前“模型能力触及危险阈值(比如能协助生物武器研发)时,必须暂停训练”的“硬性红线”,取而代之的是“路线图、风险报告与外部评审”这种更“灵活”的透明度机制。

这不免让人质疑:Anthropic 口中的“底线”,到底是坚不可摧的原则,还是会根据情况“漂移”的商业策略?当它站在聚光灯下捍卫底线时,背地里却又悄悄“拆掉”了一些自我约束的“安全之锁”。这波操作,有点耐人寻味。

1.5 特朗普的“神来之笔”:一纸禁令,全盘封杀

这出大戏的最高潮,莫过于特朗普的“神来之笔”。他在社交平台直接下令,要求美国所有政府机构“立即停止”使用 Anthropic 的技术,并设置了 6 个月的过渡期。

这一下,性质就变了。从国防部与一家公司的合同纠纷,直接上升到了政治层面。特朗普声称 Anthropic 的“自私自利正将美国人的生命置于险境”,直接把“道德底线”问题上升到了“国家安全”层面。

这操作,除了是对 Anthropic 的“报复”,更像是给所有想跟政府玩“伦理游戏”的科技公司敲响警钟:别以为有钱有技术就能在我这儿立规矩。

1.6 独立开发者与 AI 创业者的思考:你的“底线”值多少钱?

📊 这场大戏,对于我们这些独立开发者和 AI 创业者来说,简直就是一本活生生的商业伦理教材。

-

明确你的“红线”: Anthropic 证明了,在某些情况下,“说不”的勇气确实能带来品牌声誉,甚至可能在长远获得更多支持。但前提是,你的“红线”必须清晰且始终如一。别一边对外说高尚,一边内部偷偷降标。

-

“AI 安全”是一门好生意: 在这个 AI 狂飙的时代,“安全”本身就是一种稀缺资源,也是一种强大的品牌背书。Anthropic 的坚持,无疑巩固了它在“安全 AI”领域的地位,即使暂时损失了 2 亿美元,长期来看可能赚得更多。

-

警惕“权力陷阱”: 政府对技术的介入,从合作到施压,甚至到强制,独立开发者和创业公司更要擦亮眼睛。在签订任何合作协议时,务必审慎评估潜在的“权力陷阱”,保护好自己的核心技术和价值观。

-

审时度势,灵活应变: Anthropic 自身的 RSP 3.0 调整,也提醒我们,所谓的“底线”并非一成不变,需要在实践中不断校准和优化。关键在于,这种调整是否公开透明,是否能经得起市场的拷问。

💡 这场 AI 与权力、伦理与商业的激烈碰撞,没有绝对的对错,只有复杂的博弈。

🚀 对我们而言,重要的是从中学习,在追求技术创新和商业成功的道路上,也要不断叩问自己的内心:

你的“底线”是什么?它,又值多少钱?

点击放大

点击放大

END